N'importe quel Mac Apple Silicon avec 16 Go de RAM ou plus peut faire tourner un modèle d'IA locale aujourd'hui, sans abonnement cloud. Des outils comme Ollama, LM Studio et OpenClaw transforment un Mac mini, un MacBook Pro ou un Mac Studio en station de travail IA privée, capable d'exécuter des LLM open source qui rivalisent avec ChatGPT et Claude. Les facteurs déterminants sont la capacité mémoire et la bande passante, pas la dernière génération de puce. C'est ce qui fait des Mac reconditionnés équipés de puces M2 Pro, M3 Pro ou M4 Pro certaines des meilleures affaires en matériel IA du moment, avec 15 à 40 % d'économie par rapport au neuf pour des performances identiques.

Le phénomène OpenClaw a considérablement accéléré cette tendance. Les Mac mini se sont retrouvés en rupture de stock sur plusieurs marchés alors que les utilisateurs se précipitent pour installer des serveurs IA dédiés chez eux et dans leurs bureaux. Les prix des Mac d'occasion ont fortement augmenté depuis février 2026, portés par la demande en matériel compatible IA.

Ce guide couvre le choix du meilleur Mac pour IA, la quantité de RAM réellement nécessaire, les meilleurs outils et modèles à utiliser, et pourquoi acheter un Mac reconditionné est la décision la plus judicieuse pour monter une station IA en 2026.

Pourquoi faire tourner une IA locale sur votre Mac ?

Les services d'IA cloud comme ChatGPT Plus et Claude Pro coûtent 20 $ par mois chacun, soit 240 $ par an et par service. Un Mac mini Apple Silicon reconditionné faisant tourner des modèles locaux élimine ces coûts récurrents tout en vous offrant un ordinateur complet.

Mais le coût n'est qu'une partie de l'équation :

- Confidentialité. Vos données ne quittent jamais votre appareil. Aucune requête n'est enregistrée sur des serveurs distants. Aucun accès tiers. C'est essentiel pour la conformité RGPD, les données sensibles soumises au secret professionnel, les politiques de données d'entreprise et la vie privée. L'auto-hébergement supprime tout transfert transfrontalier de données.

- Pas de connexion internet requise. Après le téléchargement initial du modèle (généralement 4 à 45 Go), tout fonctionne hors ligne. Utilisez l'IA dans l'avion, en zone isolée ou pendant une coupure réseau.

- Aucune limite d'utilisation. Pas de quota journalier de messages, pas de ralentissement aux heures de pointe, pas de file d'attente. Le modèle tourne aussi vite que votre matériel le permet, aussi souvent que vous le souhaitez.

- Personnalisation. Choisissez parmi des centaines de modèles open source. Affinez-les pour des tâches spécifiques. Changez de modèle en quelques secondes. Aucune dépendance à un fournisseur.

L'IA locale n'est pas un compromis par rapport aux services cloud. Les modèles open source comme Qwen 3, Llama 3.3 et DeepSeek R1 égalent ou surpassent les performances de GPT-4 sur de nombreux benchmarks. Les faire tourner sur votre Mac vous donne un contrôle total, sans aucun coût récurrent.

L'effet OpenClaw : pourquoi les Mac mini sont en rupture de stock

OpenClaw est un agent IA autonome open source créé par le développeur autrichien Peter Steinberger. Publié initialement sous le nom de « Clawdbot » en novembre 2025 puis renommé OpenClaw en janvier 2026, il a accumulé plus de 247 000 étoiles sur GitHub et figure parmi les projets open source à la croissance la plus rapide de l'histoire.

Contrairement à Ollama ou LM Studio, OpenClaw n'est pas un outil de conversation avec l'IA. C'est un agent IA personnel qui se connecte à des LLM (cloud ou locaux via Ollama) et utilise des plateformes de messagerie comme WhatsApp, Slack, Discord et iMessage comme interface. Il fonctionne 24h/24, surveille vos messages, exécute des tâches multi-étapes, gère des fichiers et automatise des workflows de manière autonome. Considérez-le comme un assistant numérique permanent installé sur votre Mac.

Pourquoi OpenClaw pousse à l'achat de Mac mini

Deux facteurs poussent les utilisateurs à acheter des Mac mini dédiés pour OpenClaw.

Fonctionnement permanent. OpenClaw est conçu pour tourner en continu. Il nécessite un ordinateur allumé 24h/24 sans faire exploser la facture d'électricité ni générer de bruit. Le Mac mini M4 consomme seulement 8 à 15 W au repos, soit environ 14 à 23 EUR par an en électricité pour un fonctionnement continu. Il est silencieux, occupe un espace minimal avec ses 12,7 x 12,7 cm et supporte sans problème les longues périodes d'activité.

Isolation de sécurité. C'est le facteur décisif. OpenClaw nécessite les autorisations Accès complet au disque et Accessibilité pour fonctionner. Un audit de sécurité de janvier 2026 a identifié 512 vulnérabilités, dont 8 classées critiques. La CVE-2026-25253 permettait une exfiltration de tokens menant à une exécution de code à distance. Plus de 230 plugins malveillants ont été publiés sur ClawHub et GitHub la première semaine. Microsoft, Kaspersky, Jamf et SMU recommandent tous d'exécuter OpenClaw sur un appareil dédié et séparé de votre ordinateur principal.

Cette recommandation crée un cas d'usage précis : acheter un second Mac, exclusivement réservé à votre agent IA, isolé de vos données personnelles et professionnelles. Un Mac mini reconditionné est la solution la plus économique.

Impact concret sur les prix des Mac

La vague OpenClaw a sensiblement modifié le marché Mac :

- Les Mac mini se sont retrouvés en rupture de stock en Chine, avec des majorations de 500 yuans (environ 67 EUR) chez les revendeurs de Pékin et Shenzhen

- Les délais de livraison des configurations haute mémoire ont atteint six semaines dans le monde entier

- Les prix des Mac d'occasion ont fortement augmenté, ATRenew ayant relevé ses prix de rachat pour accroître l'offre, et les prix printaniers se maintiennent à des niveaux habituellement observés pendant les périodes de fêtes

- Le PDG d'Apple Tim Cook a reconnu des contraintes d'approvisionnement sur les puces avancées, le stockage et la mémoire

- Près de 1 000 personnes ont fait la queue au siège de Tencent à Shenzhen pour obtenir de l'aide à l'installation d'OpenClaw sur place

Jeremy Ji, directeur de la stratégie d'ATRenew, a déclaré à CNBC : « Nous constatons une demande croissante pour les ordinateurs portables et de bureau dans leur ensemble, mais les appareils Mac profitent de cette tendance plus que tous les autres. »

Quel Mac pour OpenClaw ?

OpenClaw lui-même est léger lorsqu'il utilise des API cloud pour le raisonnement. Le choix du matériel dépend de votre volonté de faire tourner aussi des modèles locaux via l'agent.

| Cas d'usage | Mac recommandé | Prix recond. estimé | Pourquoi |

|---|---|---|---|

| OpenClaw avec API cloud uniquement | Mac mini M4, 16 Go | 440-490 EUR | Suffisant pour l'agent plus 2-3 sous-agents |

| OpenClaw + petits modèles locaux (8B) | Mac mini M4, 16 Go, 512 Go SSD | ~650 EUR | Place pour un modèle local plus les logs et fichiers mémoire |

| OpenClaw + modèles locaux puissants (32B) | Mac mini M4 Pro, 48 Go | 1 350-1 490 EUR | Fait tourner Qwen3-Coder:32B en local pour le tool calling, le modèle recommandé par la communauté pour OpenClaw |

| OpenClaw pour une équipe (multi-agent) | Mac Studio M2 Ultra, 192 Go | Variable | Sert plusieurs agents et utilisateurs simultanément |

Pour un fonctionnement sans écran (headless), vous aurez besoin d'un adaptateur HDMI factice (environ 8 à 10 EUR) afin d'empêcher macOS de désactiver les fonctions de capture d'écran dont OpenClaw dépend.

Comparez les prix des Mac mini Apple Silicon reconditionnés.

Mac mini et Mac Studio comme serveurs IA dédiés

La tendance OpenClaw s'inscrit dans un mouvement plus large : les utilisateurs installent des Mac comme serveurs IA auto-hébergés, fonctionnant en permanence, pour la confidentialité, la réduction des coûts et l'indépendance vis-à-vis des fournisseurs cloud.

Pourquoi le Mac mini fonctionne comme serveur IA domestique

| Critère | Mac mini | PC/Carte graphique classique |

|---|---|---|

| Consommation au repos | 5-15 W | 50-150 W |

| Consommation en inférence IA | 15-30 W | 200-400 W |

| Électricité annuelle (24h/24) | 14-23 EUR | 140-370+ EUR |

| Bruit au repos | Silencieux (sans ventilateur) | Audible |

| Format | 12,7 x 12,7 cm | Tour complète |

| RAM max pour l'IA | 48-64 Go (mémoire unifiée) | 8-24 Go (VRAM GPU) |

| Complexité d'installation | Prêt à l'emploi | Installation de pilotes, configuration CUDA |

Au-delà d'OpenClaw et des LLM locaux, les utilisateurs font tourner des serveurs Mac mini pour des assistants de code privés (alternatives auto-hébergées à Copilot), du traitement de documents via des pipelines RAG, des services de traduction hors ligne, des assistants vocaux locaux et des intégrations Home Assistant avec une IA respectueuse de la vie privée.

Quand choisir un Mac Studio à la place

Le Mac mini plafonne à 64 Go de mémoire unifiée avec la puce M4 Pro. Pour la plupart des tâches d'IA locale, c'est largement suffisant. Mais si vous devez faire tourner des modèles de 70B+ paramètres en qualité maximale, servir l'IA à plus de quelques utilisateurs simultanés ou exécuter plusieurs agents OpenClaw pour une équipe, le Mac Studio M2 Ultra est le cran au-dessus.

| Critère | Mac mini M4 Pro | Mac Studio M2/M3 Ultra |

|---|---|---|

| RAM max | 64 Go | 192 Go |

| Bande passante mémoire | 273 Go/s | 800 Go/s |

| Taille de modèle confortable | Jusqu'à 32B | Jusqu'à 200B+ |

| Service multi-utilisateurs | 1-2 utilisateurs | 10+ utilisateurs |

| Consommation | 15-30 W | 50-150 W |

| Idéal pour | IA personnelle, un agent OpenClaw | Serveur IA d'équipe, multi-agent, recherche |

Un Mac Studio M2 Ultra avec 192 Go et 800 Go/s de bande passante génère des tokens environ trois fois plus vite qu'un Mac mini M4 Pro sur le même modèle. La différence de prix est significative, mais pour les équipes remplaçant plusieurs abonnements IA cloud, le calcul devient vite rentable.

Consultez les prix des Mac Studio M2 Ultra reconditionnés.

Ce qui fait des Mac le matériel idéal pour l'IA locale

Apple Silicon possède un avantage structurel par rapport aux PC classiques pour exécuter des LLM : l'architecture mémoire unifiée.

Sur un PC Windows, les modèles d'IA sont limités par la VRAM du GPU. Une carte graphique gaming typique dispose de 8 à 24 Go de mémoire vidéo dédiée. Si le modèle ne tient pas dans la VRAM, les performances s'effondrent. Sur un Mac, le CPU et le GPU partagent le même pool mémoire. Un Mac mini M4 Pro avec 48 Go de mémoire unifiée donne au modèle d'IA accès à la totalité des 48 Go. Pas de séparation artificielle entre RAM système et mémoire GPU.

C'est déterminant car la vitesse d'inférence d'un LLM local dépend de deux facteurs : la quantité de mémoire disponible (qui détermine quels modèles peuvent être chargés) et la vitesse de lecture de cette mémoire (qui détermine la vitesse de génération des tokens). Apple Silicon excelle sur les deux plans :

| Puce | Bande passante mémoire | RAM max | Neural Engine |

|---|---|---|---|

| M1 | 68 Go/s | 16 Go | 11 TOPS |

| M2 | 100 Go/s | 24 Go | 15,8 TOPS |

| M2 Pro | 200 Go/s | 32 Go | 15,8 TOPS |

| M3 Pro | 150 Go/s | 36 Go | 18 TOPS |

| M3 Max | 300-400 Go/s | 128 Go | 18 TOPS |

| M4 | 120 Go/s | 32 Go | 38 TOPS |

| M4 Pro | 273 Go/s | 48 Go | 38 TOPS |

| M4 Max | 546 Go/s | 128 Go | 38 TOPS |

| M5 Pro | 307 Go/s | 48 Go | 38+ TOPS |

| M2 Ultra | 800 Go/s | 192 Go | 31,6 TOPS |

| M3 Ultra | 800 Go/s | 192 Go | 36 TOPS |

Point essentiel pour les acheteurs de Mac reconditionnés : la bande passante mémoire compte davantage que la génération de puce pour l'inférence de LLM. Un M3 Max à 400 Go/s génère des tokens plus rapidement qu'un M4 Pro à 273 Go/s sur le même modèle. Les puces Max et Ultra de la génération précédente sont d'excellentes affaires en reconditionné pour les charges de travail IA, car elles offrent une bande passante supérieure à un prix inférieur.

Le framework MLX d'Apple, conçu spécifiquement pour cette architecture, offre une inférence 20 à 30 % plus rapide que llama.cpp sur le même matériel. Des outils comme LM Studio utilisent automatiquement MLX sur Apple Silicon.

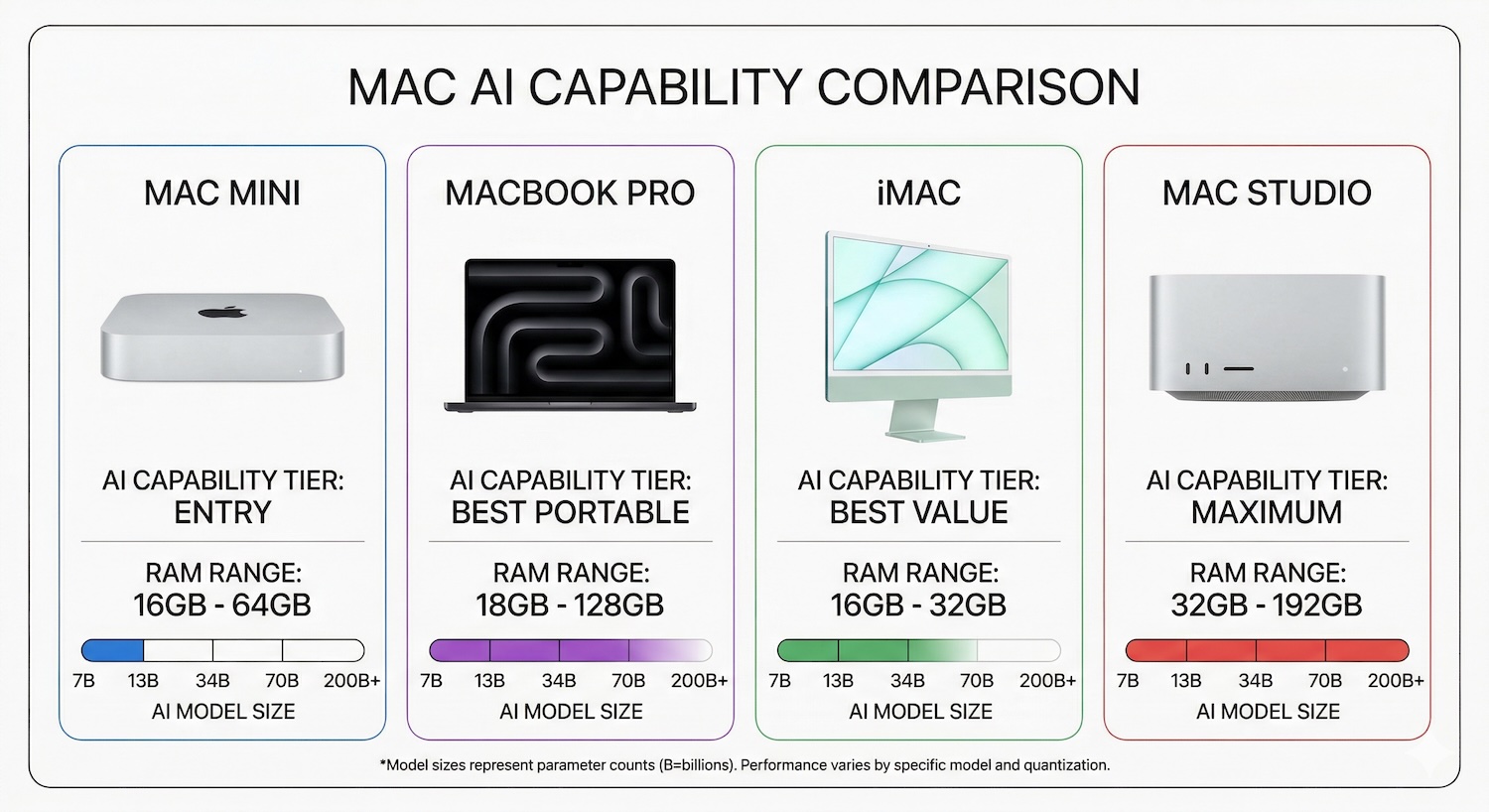

De combien de RAM avez-vous besoin ?

La RAM est la caractéristique la plus importante pour l'IA locale. La règle générale : le fichier de votre modèle ne doit pas dépasser 60 à 70 % de la RAM totale, en réservant de la marge pour macOS, la fenêtre de contexte (cache KV) et les autres applications.

| Taille du modèle | RAM nécessaire | Exemples de modèles | Ce que ça permet |

|---|---|---|---|

| 3B-4B | 8 Go minimum | Llama 3.2 3B, Phi-4 Mini, Gemma 3 4B | Questions-réponses basiques, résumé, aide simple au code |

| 7B-8B | 16 Go minimum | Qwen 3 8B, Llama 3.1 8B, Mistral 7B | Chat général, génération de code, aide à la rédaction |

| 12B-14B | 24 Go minimum | Qwen 3 14B, DeepSeek-R1-Distill-14B | Raisonnement avancé, code complexe, rédaction professionnelle |

| 30B-32B | 48 Go recommandé | Qwen 3 32B, DeepSeek-R1-Distill-32B | Qualité proche de GPT-4 pour la plupart des tâches |

| 70B | 64-96 Go | Llama 3.3 70B, Qwen 2.5 72B | IA locale de niveau frontier, rivalise avec les modèles cloud |

| 200B+ | 128 Go+ | Qwen3 235B-A22B (quantifié) | Niveau recherche, capacité maximale |

La plupart des modèles sont distribués en formats quantifiés (Q4_K_M est le standard pour l'utilisation locale). Un modèle de 70B paramètres en quantification Q4 occupe environ 40 à 45 Go sur disque et à peu près autant en RAM pendant l'inférence. Un Mac avec 64 Go peut le faire tourner, mais 96 Go offrent une marge confortable.

Pour la majorité des utilisateurs, 16 à 48 Go couvrent la fourchette idéale. Un Mac à 16 Go fait bien tourner les modèles 7B-8B. Un Mac à 48 Go fait tourner des modèles 32B qui approchent la qualité de GPT-4 en codage, rédaction et raisonnement.

Meilleurs Mac pour l'IA locale (classés par rapport qualité-prix)

Meilleur rapport qualité-prix : Mac mini M4 Pro (48 Go)

Le Mac mini M4 Pro avec 48 Go de mémoire unifiée est la station de travail IA au meilleur rapport qualité-prix disponible en 2026. Il fait tourner les modèles 32B confortablement et gère les 70B en quantification Q4 avec une marge un peu juste. À 273 Go/s de bande passante mémoire, la vitesse de génération atteint 12 à 22 tokens par seconde sur les modèles 32B, ce qui est plus rapide qu'une vitesse de lecture confortable.

Prix neuf : 2 199 EUR. Reconditionné : 1 490 à 1 580 EUR. Soit 300 à 400 EUR d'économie sur un matériel identique. Il consomme environ 30 W en charge IA et reste quasi silencieux.

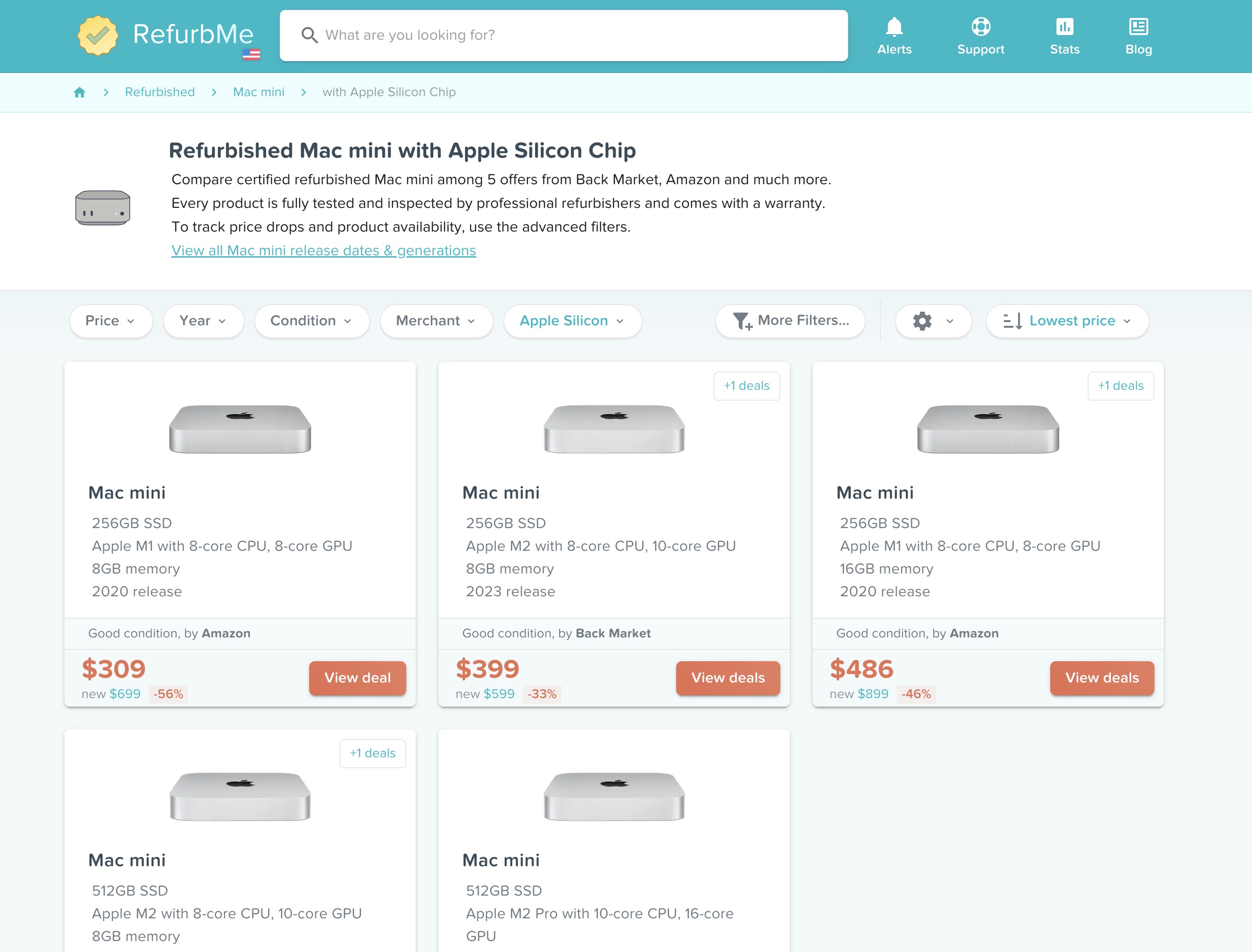

Comparez les prix des Mac mini Apple Silicon sur RefurbMe.

Meilleur choix portable : MacBook Pro M4 Pro (48 Go)

La même puce et la même mémoire que le Mac mini M4 Pro, avec en plus un écran, un clavier et une batterie. Vous ne sacrifiez rien en performances IA et gagnez la portabilité. Si vous avez besoin d'un ordinateur portable de toute façon, le MacBook Pro M4 Pro est la meilleure machine IA portable du marché.

Prix neuf : 3 199 EUR. Reconditionné : 2 140 à 2 330 EUR. Un MacBook Pro Apple Silicon reconditionné avec puce M4 Pro fait exactement la même chose qu'un neuf.

Parcourez les offres de MacBook Pro reconditionné M4 Pro.

Le bon plan d'entrée de gamme : Mac mini M2 Pro (32 Go)

Les lancements des M4 et M5 ont fait chuter les prix des M2 Pro sur le marché du reconditionné. Un Mac mini M2 Pro avec 32 Go se trouve entre 770 et 840 EUR, et il gère les modèles 14B sans problème avec assez de marge pour une utilisation basique de modèles 32B en quantification réduite. À 200 Go/s de bande passante, il est plus lent que les puces récentes mais parfaitement utilisable pour les tâches IA courantes.

C'est le meilleur point d'entrée pour quiconque souhaite tester l'IA locale sans investissement majeur.

Trouvez des offres de Mac mini Apple Silicon reconditionnés.

Capacité maximale : Mac Studio M2 Ultra (192 Go)

Pour faire tourner des modèles 70B en qualité maximale ou expérimenter avec des modèles de 200B+ paramètres, rien ne surpasse le Mac Studio équipé d'une puce Ultra. Le M2 Ultra avec 192 Go de mémoire unifiée et 800 Go/s de bande passante est une machine de recherche IA qui tient sur un bureau et consomme une fraction de l'énergie d'un PC à GPU comparable.

Consultez les prix des Mac Studio M2 Ultra reconditionnés.

Le choix malin en vitesse : MacBook Pro M3 Max (48-96 Go)

Voici le choix d'initié. Le M3 Max à 400 Go/s de bande passante mémoire génère des tokens plus vite que le M4 Pro à 273 Go/s. Avec les M5 Pro et M5 Max désormais en vente, les machines M3 Max affluent sur les canaux reconditionnés avec des remises importantes. Un MacBook Pro M3 Max avec 48 Go offre un meilleur débit IA brut qu'un M4 Pro neuf, souvent à un prix inférieur.

Tout-en-un : iMac M4 (32 Go)

L'iMac Apple Silicon reconditionné M4 avec 32 Go gère correctement les modèles 7B à 14B pour une utilisation IA occasionnelle. Si vous voulez un appareil unique avec un écran Retina 4,5K intégré et une capacité d'IA locale correcte, l'iMac remplit ce créneau. Ce n'est pas une machine pensée pour l'IA, mais elle fait le travail pour les charges légères.

Tableau comparatif

| Modèle Mac | Options RAM | Bande passante | Taille de modèle optimale | Prix recond. estimé | Note IA |

|---|---|---|---|---|---|

| Mac mini M4 | 16-32 Go | 120 Go/s | 7B-8B | 440-490 EUR | Entrée de gamme |

| Mac mini M4 Pro | 24-48 Go | 273 Go/s | 14B-70B | 1 020-1 580 EUR | Meilleur rapport qualité-prix |

| MacBook Pro M4 Pro | 24-48 Go | 273 Go/s | 14B-70B | 2 140-2 330 EUR | Meilleur portable |

| MacBook Pro M3 Max | 48-96 Go | 300-400 Go/s | 32B-70B | 2 050-2 610 EUR | Choix malin en vitesse |

| MacBook Pro M4 Max | 36-128 Go | 546 Go/s | 70B+ | 2 510+ EUR | Pro |

| Mac Studio M2 Ultra | 64-192 Go | 800 Go/s | 70B-200B+ | Variable | Maximum |

| Mac Studio M3 Ultra | 96-192 Go | 800 Go/s | 70B-200B+ | Variable | Maximum |

| iMac M4 | 16-32 Go | 120 Go/s | 7B-14B | 1 300-1 490 EUR | Occasionnel |

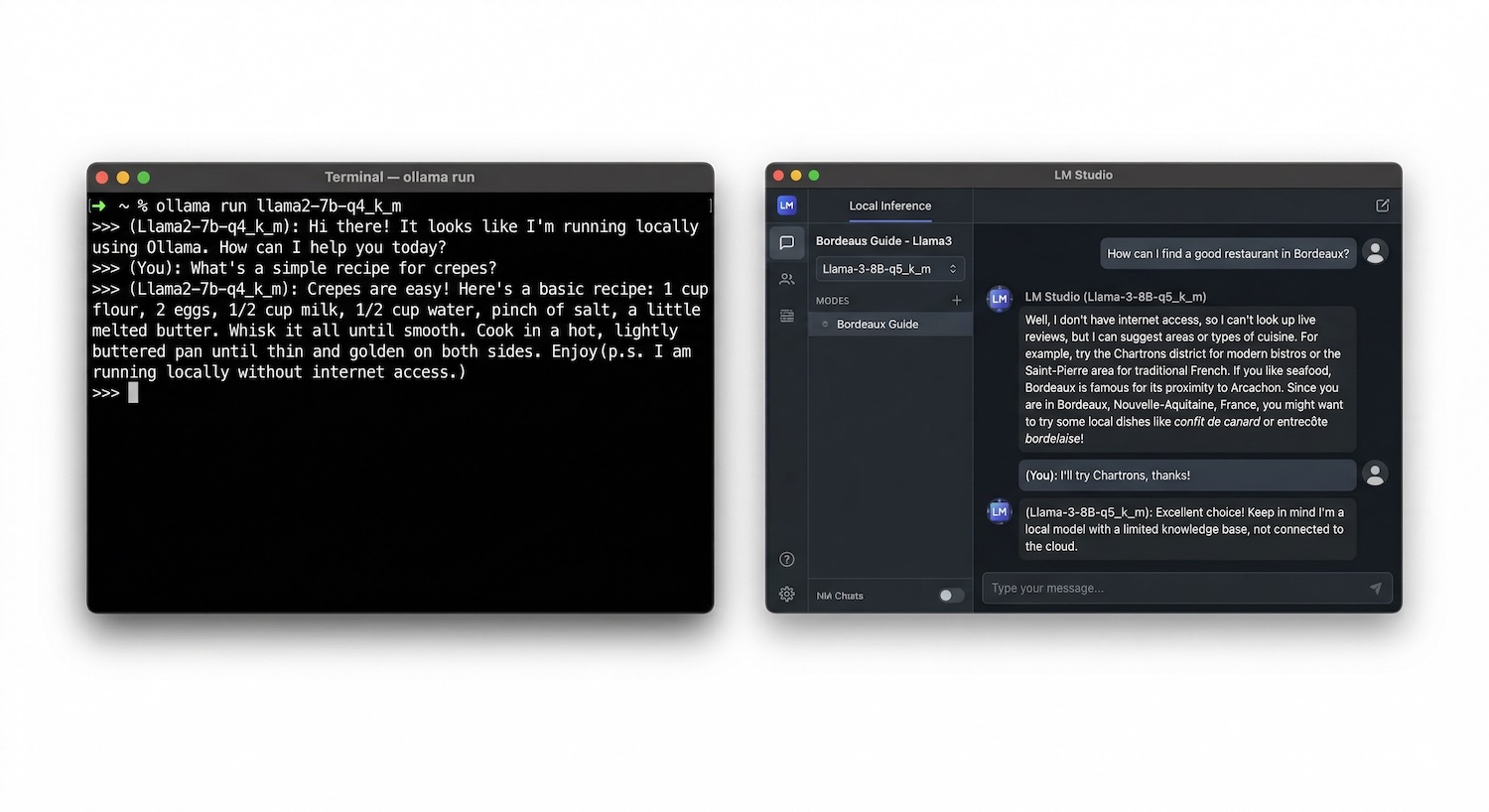

Meilleurs outils pour faire tourner l'IA sur Mac

Quatre outils dominent le paysage de l'IA locale sur Mac. Tous sont gratuits.

Ollama est un outil en ligne de commande qui rend l'exécution de modèles IA aussi simple que de taper ollama run llama3.2. Il expose une API compatible OpenAI, ce qui permet aux développeurs de brancher des modèles locaux sur n'importe quelle application supportant le format OpenAI. Léger (environ 100 Mo de surcharge RAM), sous licence MIT, c'est le choix le plus populaire pour les développeurs et l'automatisation.

LM Studio est une application de bureau avec une interface de chat visuelle et un navigateur de modèles. Elle prend en charge les formats GGUF (llama.cpp) et MLX. Les modèles MLX via LM Studio sont plus économes en mémoire que les modèles GGUF via Ollama, offrant 20 à 30 % de performances supplémentaires sur Apple Silicon. Idéal pour les utilisateurs non techniques qui veulent une expérience de type ChatGPT fonctionnant entièrement sur leur Mac.

MLX est le framework de machine learning open source d'Apple, conçu spécifiquement pour Apple Silicon. Il offre les vitesses d'inférence les plus rapides sur matériel Mac. Disponible via des API Python, Swift, C++ et C. Prend en charge le fine-tuning local. Idéal pour les ingénieurs ML et développeurs qui recherchent les performances maximales.

llama.cpp est le moteur sous-jacent d'Ollama. Utilisez-le directement si vous voulez un contrôle total sur chaque paramètre d'inférence. Licence MIT, multiplateforme.

Guide de décision rapide : Si vous écrivez du code, commencez par Ollama. Si vous préférez une interface de chat visuelle, commencez par LM Studio. Si vous avez besoin de la vitesse maximale, utilisez MLX directement.

Meilleurs modèles d'IA à faire tourner en local en 2026

| Cas d'usage | Modèle | Taille du téléchargement | RAM min | Pourquoi celui-ci |

|---|---|---|---|---|

| Chat général | Qwen 3 8B Q4 | ~5 Go | 16 Go | Meilleur polyvalent dans cette catégorie de taille |

| Assistant de code | Qwen 2.5 Coder 32B Q4 | ~20 Go | 48 Go | 92,7 % sur HumanEval, bat GPT-4o |

| Raisonnement et maths | DeepSeek-R1-Distill-14B Q4 | ~9 Go | 24 Go | Raisonnement en chaîne de pensée dans un format compact |

| Rédaction créative | Llama 3.3 70B Q4 | ~40 Go | 96 Go | Excellente qualité de contenu long |

| Travaux sensibles | N'importe quel modèle local | Variable | 16 Go+ | Aucune donnée ne quitte votre machine |

| Tâches multilingues | Qwen 3 (toutes tailles) | Variable | 16 Go+ | Prend en charge 29+ langues nativement |

Le paysage des modèles open source évolue rapidement. La bibliothèque de modèles d'Ollama et Hugging Face hébergent des milliers de modèles. Commencez par Qwen 3 8B si vous avez 16 Go de RAM, ou Qwen 3 32B si vous en avez 48. Les deux offrent de solides performances sur les tâches générales.

Pourquoi le reconditionné a du sens pour les charges IA

La RAM est l'option de configuration Mac la plus coûteuse, et elle est soudée à la carte mère. Impossible de l'augmenter par la suite. Sur un Mac mini M4 Pro, passer de 24 Go à 48 Go ajoute environ 230 EUR au prix neuf. Sur un MacBook Pro, les configurations haute mémoire dépassent rapidement les 3 000 EUR.

Les Mac reconditionnés offrent la même puce, la même RAM, les mêmes performances, simplement à un prix inférieur. Un MacBook Pro Apple Silicon reconditionné avec 48 Go de mémoire unifiée fonctionne de manière identique à un neuf pour l'inférence IA. Le silicium ne vieillit pas.

Trois raisons d'acheter du reconditionné pour l'IA en particulier :

La fenêtre de timing M5. Apple a lancé les M5 Pro et M5 Max en mars 2026. Les machines M3 Pro, M3 Max, M4 Pro et M4 Max affluent donc sur les canaux reconditionnés avec les remises les plus importantes que nous ayons observées. C'est le meilleur moment pour acheter des machines Pro et Max de la génération précédente pour l'IA.

Les modèles d'IA n'ont pas besoin de la dernière puce. La bande passante mémoire et la capacité RAM déterminent les performances IA. Un M3 Max avec 96 Go à 400 Go/s est une meilleure machine IA qu'un M5 neuf avec 24 Go à 307 Go/s. Acheter la génération précédente signifie souvent plus de RAM pour moins d'argent, ce qui se traduit directement par la possibilité de faire tourner des modèles plus grands et plus performants.

Coût total vs abonnements cloud. Un Mac mini M2 Pro reconditionné avec 32 Go à environ 790 EUR remplace 240 $ par an d'abonnements IA cloud. Il est rentabilisé en 3,5 ans environ, tout en vous offrant un ordinateur de bureau complet. Après cela, chaque année d'utilisation est du bénéfice net.

Faire tourner une IA sur un Mac reconditionné est aussi un geste pour la durabilité. Vous prolongez la durée de vie du matériel existant et réduisez la demande énergétique des centres de données cloud. Deux bénéfices environnementaux en un seul achat.

RefurbMe compare les prix entre l'Apple Store Refurbished, Amazon Renewed, Back Market et d'autres vendeurs de confiance pour vous aider à trouver la meilleure offre sur la configuration RAM et puce exacte dont vous avez besoin.

Démarrage rapide : votre premier modèle d'IA locale

La mise en route prend moins de cinq minutes. Voici la méthode la plus rapide avec Ollama :

- Téléchargez Ollama depuis ollama.com et faites-le glisser dans votre dossier Applications.

- Ouvrez Terminal (appuyez sur Commande + Espace, tapez « Terminal », appuyez sur Entrée).

- Tapez

ollama run qwen3:8bet appuyez sur Entrée. Ollama télécharge automatiquement le modèle (environ 5 Go). - Commencez à discuter. Tapez n'importe quelle requête et appuyez sur Entrée. Tout tourne en local sur votre Mac.

Si vous préférez une interface visuelle, téléchargez LM Studio depuis lmstudio.ai. Ouvrez-le, parcourez le catalogue de modèles, cliquez sur Télécharger pour un modèle recommandé, puis cliquez sur Chat. Aucun terminal nécessaire.

Les deux outils sont gratuits. Pas de compte requis. Aucune donnée envoyée où que ce soit. Après le téléchargement initial du modèle, tout fonctionne entièrement hors ligne.

Si vous avez 48 Go de RAM, essayez ollama run qwen3:32b pour un saut qualitatif significatif. Pour les tâches de codage, ollama run qwen2.5-coder:32b est le leader actuel des benchmarks parmi les modèles open source.

FAQ

Peut-on faire tourner ChatGPT en local sur un Mac ?

Vous ne pouvez pas exécuter ChatGPT lui-même en local. ChatGPT est un service propriétaire d'OpenAI. En revanche, des modèles open source comme Qwen 3, Llama 3.3 et DeepSeek R1 rivalisent avec les capacités de ChatGPT sur de nombreuses tâches. Des outils comme Ollama et LM Studio vous permettent de les exécuter en local avec une expérience de chat similaire, gratuitement et en toute confidentialité.

De combien de RAM a-t-on besoin pour faire tourner une IA sur Mac ?

Le minimum est de 8 Go pour les petits modèles 3B paramètres. Pour une IA réellement utile, 16 Go gèrent bien les modèles 7B-8B. 24 à 48 Go donnent accès aux modèles 14B-32B qui approchent la qualité de GPT-4. 64 Go ou plus permettent de faire tourner les modèles frontier 70B en local.

Un Mac reconditionné est-il suffisant pour faire tourner une IA locale ?

Oui. Les Mac reconditionnés offrent des performances identiques aux Mac neufs. La puce, la RAM et la bande passante mémoire, les trois caractéristiques déterminantes pour l'IA, sont les mêmes que le Mac soit neuf ou reconditionné. Un Mac mini M4 Pro reconditionné avec 48 Go est la même station de travail IA qu'un neuf, simplement à un prix inférieur. Découvrez les avantages et inconvénients des MacBook reconditionnés.

A-t-on besoin d'une connexion internet pour l'IA locale ?

Uniquement pour le téléchargement initial du modèle, qui va de 4 à 45 Go selon la taille. Après cela, tout fonctionne entièrement hors ligne. Pas de connexion internet, pas de serveurs cloud, aucune donnée ne quitte votre Mac.

Ollama ou LM Studio : lequel est le meilleur sur Mac ?

Les deux sont excellents et gratuits. Ollama convient mieux aux développeurs qui veulent un accès API et des workflows en terminal. LM Studio convient mieux à tous les autres grâce à son interface visuelle et son optimisation MLX, qui offre 20 à 30 % de performances supplémentaires sur Apple Silicon. De nombreux utilisateurs installent les deux.

Peut-on faire tourner une IA sur un Mac Intel ?

Techniquement oui via llama.cpp, mais les performances sont médiocres sans la mémoire unifiée et l'accélération GPU d'Apple Silicon. Les petits modèles 3B tournent lentement. Tout ce qui est plus gros est impraticable. Pour toute utilisation sérieuse d'IA locale, il faut une puce M1 ou ultérieure. Si vous êtes encore sur Intel, consultez notre guide pour savoir si les Mac Intel sont obsolètes.

Quel est le meilleur Mac pour IA en rapport qualité-prix en 2026 ?

Le Mac mini M4 Pro reconditionné avec 48 Go de mémoire unifiée. Il fait tourner les modèles 32B confortablement, gère les modèles 70B en quantification Q4, consomme peu d'énergie, reste quasi silencieux et se trouve en reconditionné entre 1 490 et 1 580 EUR. Comparez les prix des Mac mini Apple Silicon entre reconditionneurs.

Qu'est-ce qu'OpenClaw et pourquoi tout le monde achète des Mac mini pour ça ?

OpenClaw est un agent IA autonome open source avec plus de 247 000 étoiles sur GitHub. Il tourne 24h/24 sur votre Mac, se connecte à des LLM via des plateformes de messagerie comme WhatsApp, Slack et iMessage pour exécuter des tâches de manière autonome. Les experts en sécurité recommandent de l'exécuter sur un appareil dédié plutôt que sur votre ordinateur principal, ce qui a fait du Mac mini le matériel par défaut en raison de sa faible consommation (14 à 23 EUR par an pour un fonctionnement 24h/24), de son fonctionnement silencieux et de son format compact. Un Mac mini reconditionné M4 à partir de 440 EUR est la solution la plus abordable pour mettre en place un serveur OpenClaw dédié.

Est-il sûr de faire tourner OpenClaw sur son Mac principal ?

Des chercheurs en sécurité ont identifié 512 vulnérabilités dans OpenClaw, dont des risques d'exfiltration de tokens et plus de 230 compétences communautaires malveillantes. Microsoft, Kaspersky, Jamf et SMU recommandent tous de faire tourner OpenClaw sur un appareil séparé et dédié, distinct de votre ordinateur professionnel ou personnel. Un Mac mini reconditionné utilisé exclusivement pour OpenClaw offre une isolation matérielle pour environ 440 à 650 EUR.

Peut-on utiliser un Mac mini comme serveur IA 24h/24 ?

Oui. Le Mac mini M4 consomme seulement 5 à 15 W au repos et 15 à 30 W en inférence IA, soit environ 14 à 23 EUR par an en électricité pour un fonctionnement continu. Il est silencieux, occupe un espace minimal et supporte bien les longues périodes d'activité. C'est le matériel le plus populaire pour l'IA auto-hébergée, que ce soit pour OpenClaw, Ollama, LM Studio ou des pipelines RAG privés.

Publié le: 28 mars 2026